반응형

📘 Base LLM (대규모 언어 모델)

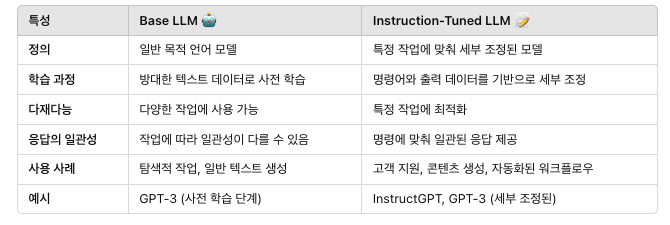

1. 정의: Base LLM은 방대한 텍스트 데이터로 사전 학습된 일반 목적 언어 모델입니다. 언어의 문법, 어휘, 일반 사용 패턴 등 언어의 통계적 특성을 학습합니다.

2. 특성:

- 사전 학습: Base LLM은 책, 기사, 웹사이트 등에서 수집된 수십억 단어의 방대한 데이터셋을 기반으로 학습됩니다. 📚

- 다재다능: 다양한 작업을 수행할 수 있지만, 특정 작업에 완벽히 맞지는 않을 수 있습니다. 🌍

- 예시: GPT-3 (Generative Pre-trained Transformer 3)는 일반적인 예입니다. 🤖

3. 사용 사례:

- 탐색적 작업: 특정 작업에 맞춘 조정 없이 다양한 작업에 사용됩니다. 🕵️♂️

- 일반 텍스트 생성: 언어에 대한 폭넓은 이해를 바탕으로 콘텐츠를 생성합니다. 📝

- 기초 모델: 세부 조정을 통해 전문화된 모델을 개발하기 위한 출발점으로 사용됩니다. 🚀

📘 Instruction-Tuned LLM (명령 조정 언어 모델)

1. 정의: Instruction-Tuned LLM은 특정 데이터셋과 명령어로 추가 조정된 기본 언어 모델입니다. 🛠️

2. 특성:

- 세부 조정: 명령과 그에 따른 출력이 포함된 데이터셋으로 학습됩니다. 📑

- 작업별 성능: 특정 작업을 더 잘 수행합니다. 💼

- 사용자 의도에 맞춤: 실제 응용 프로그램에서 더 효과적입니다. 🎯

3. 사용 사례:

- 고객 지원: 고객 문의에 정확하고 맥락에 맞는 응답을 제공합니다. 💬

- 콘텐츠 생성: 특정 가이드라인이나 요구 사항에 따라 텍스트를 생성합니다. 📝

- 자동화된 워크플로우: 복잡한 작업을 수행하는 데 사용됩니다. 🛠️

명령 조정 LLM의 예시:

- GPT-3 (세부 조정된): 글쓰기 도우미나 코딩 도우미와 같은 특정 응용 프로그램을 위해 세부 조정된 버전. ✍️

- InstructGPT: 명령을 더 잘 따르고 더 정확하고 관련성 높은 응답을 제공하도록 세부 조정된 GPT-3의 변형. 🎯

요약 ✨

- Base LLM은 방대한 텍스트 데이터로 학습되어 인간 언어를 이해하고 생성하는 데 사용되는 일반 목적의 모델입니다. 🌍 다재다능하지만 특정 작업에 최적화되지 않았습니다. 📚

- Instruction-Tuned LLM은 특정 작업을 더 효과적으로 수행하도록 추가 세부 조정된 모델입니다. 🛠️ 추가 세부 조정 과정을 통해 특정 작업 응용 프로그램에서 향상된 성능을 제공합니다. 🚀

반응형

'AI 개발 > LLM' 카테고리의 다른 글

| [LLM]🌟 언어 모델에서 토큰(Token)이란 무엇인가? (0) | 2024.06.17 |

|---|---|

| [LLM] 🌟 OpenAI 텍스트 생성 API: 시작하기 (1) | 2024.06.15 |

| [Transformer] 트랜스포머 포지셔널 인코딩 (Positional Encoding) 쉽게 설명하기 📏 (3) | 2024.05.30 |

| [Transformer] Transformer 트랜스포머 모델: 인코더와 디코더의 자세한 순서별 설명 📚 (2) | 2024.05.29 |

| [LLM] 정보 검색(Information Retrieval): 디지털 세계의 나침반 🧭 (62) | 2024.03.08 |